Beyond Geometry

Paper:Beyond Geometry: Artistic Disparity Synthesis for Immersive 2D-to-3D

模型解决的核心问题:

- 现在的深度估计算法往往用来还原物理世界的真实距离,但是在电影里,深度是用来讲故事的。比如有的镜头是导演故意设计的,但是会误判为噪声。

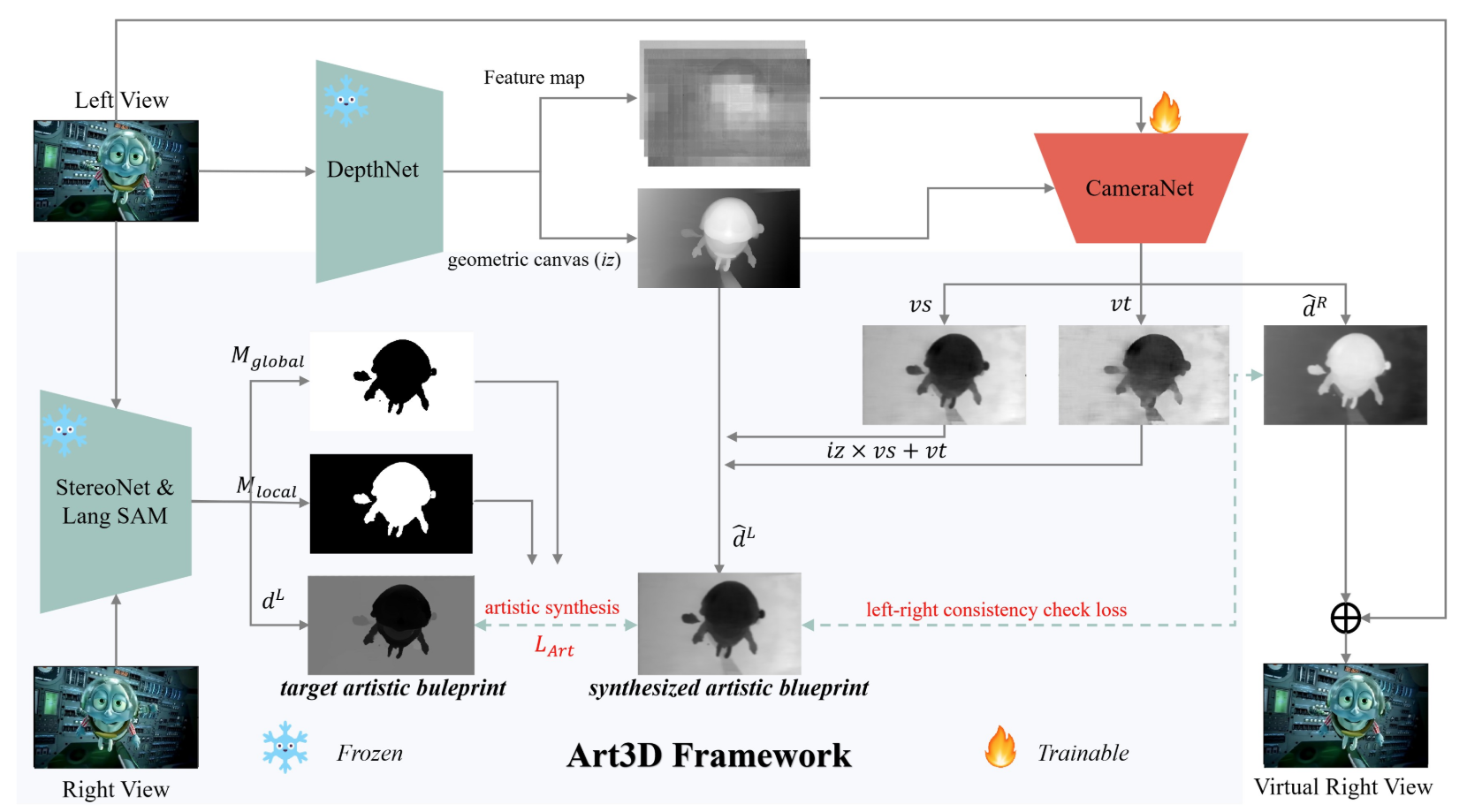

为了同时模拟导演对宏观和微观的把控,将视差建模为:

其中

然后 StereoNet 输入左右视图的视频后,得到输出的深度

Lang SAM 根据文本提示,例如:

- Non-human out-of-screen object”(非人类的出窗物体,例如飞来的石块或箭镞) 。

- “Foreground character pop-out”(前景角色弹出,用于强调主角的立体感) 。

得到需要特殊注意的掩码

然后计算剩下的作为背景全局掩码

论文最后的损失函数如下:

第一部分是艺术合成损失:

背景和突出物体分别计算损失,然后再加一个全局正则损失

第二部分是几何一致性损失:

包含平滑度损失和左右一致性损失。

StereoNet 是什么?

用于生成深度图,和 DepthNet 不同,它的输入是双目。

| 对比维度 | StereoNet (谷歌, ECCV 2018) | DepthNet (有多个版本) |

|---|---|---|

| 📥 输入数据 | 双目图像 (左图 + 右图) | 单目图像 (一张图) 或视频序列 |

| ⚙️ 核心原理 | 几何匹配寻找左右图对应点,通过三角测量计算深度 | 深度猜测通过网络学习从二维图像到三维深度的映射关系 |

| 🎯 核心优势 | 高精度、绝对尺度通过已知的“双目基线”距离,能得到真实的物理深度 | 成本低、适用广只需要一个普通摄像头,适用性更强 |

| ⏱️ 速度 | 极快 (可达 60 FPS)专为实时应用设计 | 相对较慢,取决于具体网络设计 |

| 🏠 应用场景 | 自动驾驶、机器人、AR/VR对精度和实时性要求高,且能搭载双目相机的场景 | 手机拍照、无人机、3D建模硬件受限或只有一个摄像头的场景 |

Beyond Geometry

https://d4wnnn.github.io/2026/04/12/Notion/Beyond Geometry/