Voyager

Paper:Long-Range and World-Consistent Video Diffusion for Explorable 3D Scene Generation,TOG,2025

论文解决了在利用单个图像进行长距离、可自由探索的3D场景视频生成时,存在的核心挑战:

- 长距离生成的空间不一致性:进行长距离镜头轨迹移动时,难以保持场景的几何连贯性。

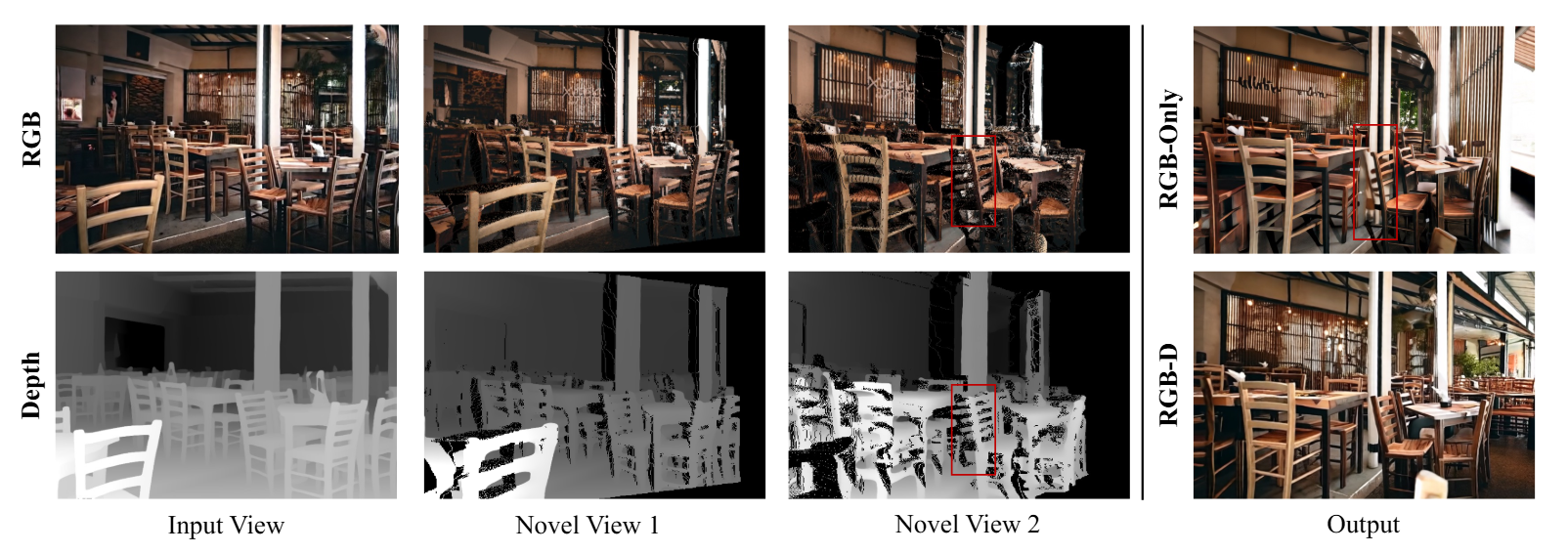

- 视觉幻觉:单纯依赖部分RGB图像作为条件引导视频生成,在复杂遮挡场景下极易产生错误的视觉内容。

- 效率低。传统方法需要先生成视频,再通过复杂的后处理重建 3D 场景。

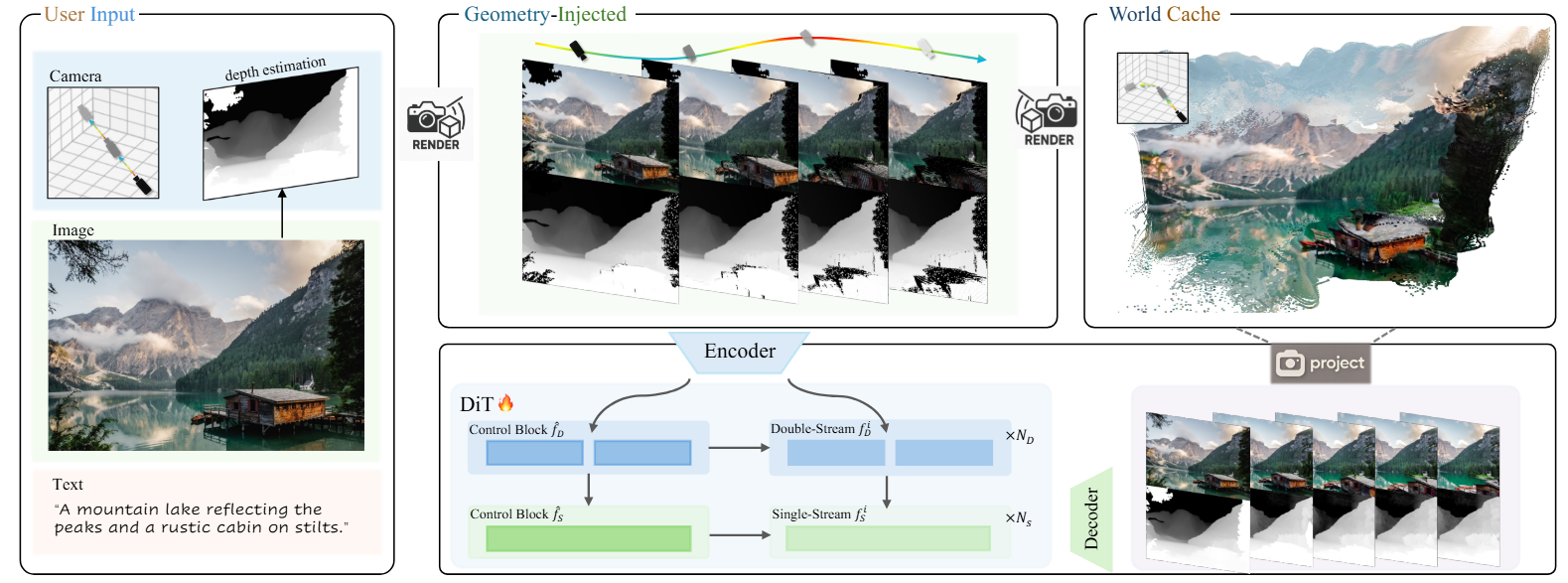

论文框架如上。

首先模型的输出除了 RGB 图像外,还有深度图。将深度图和 RGB

图像进行反投影构建 3D 点云

反投影:从 2D 图像到 3D 空间。

然后根据新视角的相机参数

- 如果

对应位置有值,模型就遵循该信息生成像素。 - 如果

对应位置没有值,模型就需要生成。

因此核心逻辑是先建立几何底座,再进行像素生成。

然后论文将深度信息和 RGB 信息在通道维度进行拼接,利用 DiT 的全局注意力机制进行交互。

在上面的公式中,

上面的

另外为了实现长距离、甚至理论上“无限”的场景探索,Voyager 还引入了如下的创新点:

随着新视频的生成,系统会增量将新帧的 RGB 和深度图反投影成 3D 点云,并存入世界缓存。为了缓解存储压力,对于已经存在的点,如果它于当前视角的表面法线夹角超过90(意味着不可见),就剔除这些点,缓解存储压力的同时能够避免多帧叠加带来的噪声积累。

为了避免视频闪烁,论文进行了平滑采样,也就是将上一个片段的生成结果作为噪声初始化的起点。然后:

- 在完成两个连续片段的推理后,系统会在重叠区域进行加权平均处理。

- 然后在重叠的区域注入轻微的噪声,进行去噪推理。

Voyager

https://d4wnnn.github.io/2026/04/22/Notion/Voyager/